توانایی تشخیص دروغ از حقیقت همواره یکی از چالشهای انسانی بوده است. ابزارهای سنتی مانند دستگاههای دروغسنج یا روشهای روانشناختی تا حدودی توانستهاند در این زمینه کمککننده باشند. با این حال دقت پایین و خطاهای زیاد آنها باعث شده است که بسیاری از این فناوریها کنار گذاشته شوند. اما اکنون، هوش مصنوعی با قدرت پردازش دادهها و توانایی تحلیل زبان طبیعی، امیدهای جدیدی را برای این چالش به ارمغان آورده است.

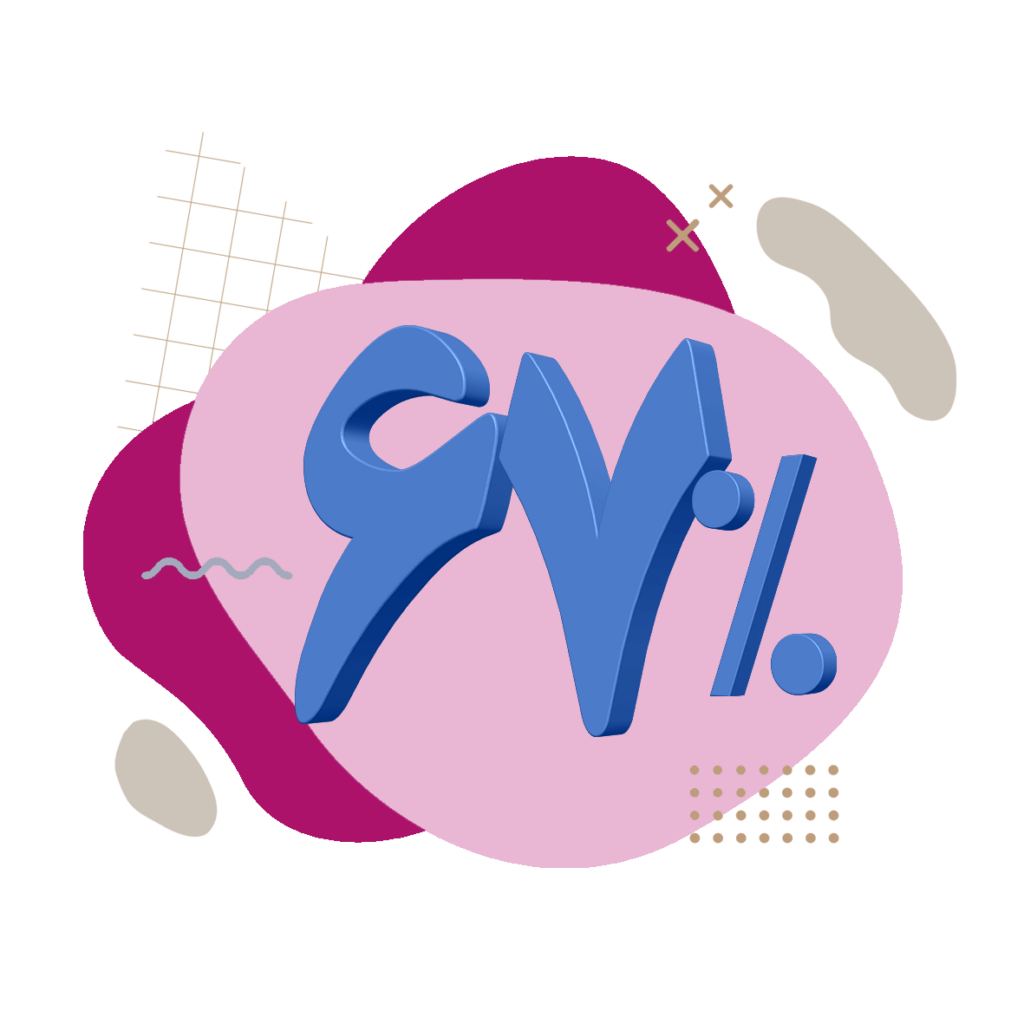

مطالعات اخیر نشان دادهاند که ابزارهای مبتنی بر هوش مصنوعی میتوانند دقتی به مراتب بالاتر از انسان در تشخیص دروغ داشته باشند. برای مثال، پژوهشی که توسطAlicia von Schenk و همکارانش انجام شد، مدلی بر اساس فناوری BERT گوگل ارائه داد که توانست با دقت ۶۷ درصد دروغها را تشخیص دهد. این میزان از دقت، گرچه هنوز ایدهآل نیست، اما نشاندهنده پیشرفت قابل توجهی نسبت به توانایی انسانها است که معمولاً تنها در ۵۰ درصد مواقع در تشخیص دروغ موفق هستند.

این فناوری در آزمایشها نشان داد که اگرچه بسیاری از افراد به استفاده از آن تمایل نشان نمیدهند، کسانی که از آن استفاده کردند به شدت به نتایج آن اعتماد داشتند. برای مثال، در یک آزمایش، تنها یکسوم از شرکتکنندگان حاضر به پرداخت هزینه برای استفاده از این ابزار شدند. اما این افراد تقریباً همیشه پیشبینیهای ابزار را پذیرفتند و به آن اعتماد کردند. همین مسئله نشان میدهد که هوش مصنوعی نه تنها میتواند بر تصمیمات ما تأثیر بگذارد، بلکه ممکن است در شکلگیری نگرشها و قضاوتها نیز نقش داشته باشد.

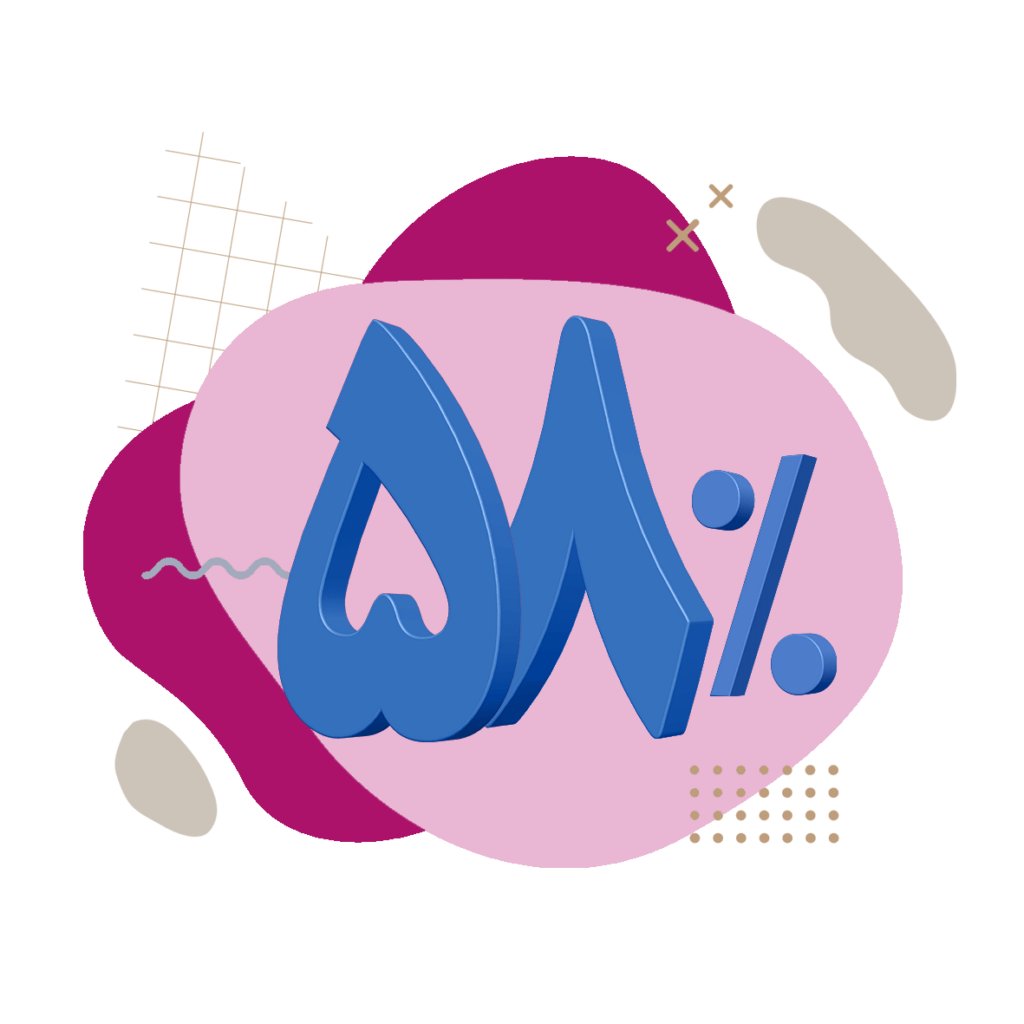

با این حال، استفاده از چنین ابزارهایی میتواند پیامدهای ناخواستهای به همراه داشته باشد. یکی از نگرانیهای عمده این است که این فناوری میتواند باعث افزایش بیاعتمادی در جامعه شود. نتایج پژوهشها نشان داد که کاربران این ابزار تمایل بیشتری به اتهام زدن داشتند. در حالی که در شرایط عادی تنها ۱۹ درصد از اظهارات به عنوان دروغ شناسایی میشدند، این عدد با استفاده از ابزار هوش مصنوعی به ۵۸ درصد افزایش یافت. این مسئله، اگرچه ممکن است در شناسایی موارد دروغ مفید باشد، اما میتواند روابط اجتماعی را تحت تأثیر منفی قرار دهد.

علاوه بر این، دقت این ابزارها همچنان جای سؤال دارد. آیا دقت ۸۰ درصد برای ابزاری که ممکن است در قضاوتهای اجتماعی، شغلی، یا حتی قانونی استفاده شود، کافی است؟ حتی اگر دقت به ۹۹ درصد برسد، هنوز احتمال خطا وجود دارد. این در حالی است که یک خطای کوچک در این زمینه میتواند پیامدهای بزرگی به همراه داشته باشد. برای مثال، استفاده گسترده از این ابزارها در ارزیابی اطلاعات موجود در رسانههای اجتماعی یا بررسی صداقت در مصاحبههای شغلی ممکن است باعث ایجاد اتهامات نادرست و کاهش اعتماد عمومی شود.

هوش مصنوعی، اگرچه پتانسیل بالایی در بهبود این روند دارد، اما به دلیل امکان گسترش سریع و استفاده وسیع، خطرات بیشتری نیز به همراه دارد. اگر این فناوریها بدون آزمایشهای دقیق و محدودیتهای مشخص به کار گرفته شوند، ممکن است بیشتر از آنکه مفید باشند، آسیبزا شوند.

استفاده از هوش مصنوعی در تشخیص دروغ فرصتی است که میتواند به شکلگیری آیندهای شفافتر کمک کند. اما این ابزارها باید با دقت و مسئولیتپذیری مورد استفاده قرار گیرند. تصمیمگیری درباره استفاده از چنین فناوریهایی نیازمند تعادل میان مزایا و معایب آن است تا نهتنها به بهبود قضاوتهای انسانی کمک کند، بلکه از آسیبهای اجتماعی و روانشناختی احتمالی نیز جلوگیری شود.

منبع: technologyreview