تصور کنید در یک گالری هنری قدم میزنید و تابلویی توجهتان را جلب میکند: کودکی با موهای آشفته در باد، با لباسی ساده و رنگهایی که حس و حال دوران ویکتوریایی را زنده میکند. حالا اگر بگویم این اثر نه توسط یک انسان، بلکه توسط هوش مصنوعی خلق شده، چه حسی به شما دست میدهد؟ این جادوی تولید عکس با هوش مصنوعی است که مرزهای خلاقیت را جابهجا کرده و سوالهای جدیدی درباره هنر، اصالت و فناوری به وجود آورده. در این مقاله، به زبان ساده، شما را با دنیای شگفتانگیز تولید عکس با هوش مصنوعی آشنا میکنیم، از نحوه کار این فناوری تا کاربردهایش و حتی چالشهایی که با خودش به همراه آورده است.

تولید عکس با هوش مصنوعی چیست؟

تولید عکس با هوش مصنوعی به معنای استفاده از شبکههای عصبی مصنوعی (مطالعه بیشتر: یادگیری ماشینی) برای خلق تصاویر جدید و واقعی از صفر است. این فناوری به شما اجازه میدهد با وارد کردن یک متن ساده، مثل «یک سیب قرمز روی درخت»، تصویری خلق کنید که دقیقاً همان چیزی را نشان دهد که توصیف کردهاید. این تصاویر میتوانند واقعی، کارتونی یا حتی به سبک نقاشیهای معروف باشند. چیزی که این فناوری را خاص میکند، توانایی آن در ترکیب سبکها، مفاهیم و ویژگیهای مختلف برای خلق تصاویری است که گاهی حتی از تخیل ما فراتر میروند. این جادو به لطف شاخهای از هوش مصنوعی به نام هوش مصنوعی مولد ممکن شده که روی خلق محتوای جدید تمرکز دارد.

این ابزارها با یادگیری از مجموعههای عظیمی از تصاویر، ویژگیها و سبکهای مختلف را درک میکنند. مثل یک نقاش که سالها تمرین کرده، این مدلهای هوش مصنوعی یاد میگیرند که چه چیزی یک تصویر را زیبا، واقعی یا خاص میکند. اما چطور این اتفاق میافتد؟

چگونگی خلق تصاویر توسط هوش مصنوعی

فرآیند تولید تصاویر توسط هوش مصنوعی یکی از دستاوردهای برجسته فناوری مدرن است که امکان خلق تصاویر بصری پیچیده و واقعی را از ورودیهای متنی فراهم میسازد. این فناوری، که در قلب ابزارهایی نظیر DALL-E، Midjourney و Stable Diffusion جای دارد، ترکیبی از الگوریتمهای پیشرفته و شبکههای عصبی است که با هماهنگی، تصاویر خلاقانهای تولید میکنند. برای درک این فرآیند، لازم است مراحل اصلی آن بهصورت گامبهگام بررسی شود: از تحلیل متن ورودی تا خلق تصویر نهایی. در ادامه، این مراحل با جزئیات شرح داده میشود.

۱. تحلیل و درک متن ورودی: تبدیل زبان انسانی به زبان ماشین

نخستین گام در تولید تصاویر توسط هوش مصنوعی، درک درخواست کاربر است که معمولاً بهصورت یک متن توصیفی (مانند «گربهای با کلاه جادوگری در جنگلی مهآلود») ارائه میشود. این متن باید به شکلی تبدیل شود که برای سیستمهای هوش مصنوعی قابلفهم باشد. این وظیفه بر عهده فناوری پردازش زبان طبیعی (NLP) است.

مدلهای پیشرفتهای مانند CLIP (Contrastive Language-Image Pre-training)، که توسط OpenAI توسعه یافته، در این مرحله نقش کلیدی دارند. این مدلها با آموزش روی مجموعههای عظیمی از تصاویر و توضیحات متنی مرتبط، توانایی اتصال مفاهیم زبانی به ویژگیهای بصری را کسب کردهاند. برای مثال، وقتی کاربر عبارت «گربه با کلاه جادوگری» را وارد میکند، مدل CLIP این متن را به یک بردار عددی چندبعدی (معروف به embedding) تبدیل میکند. این بردار، که حاوی اطلاعات معنایی و ساختاری متن است، بهعنوان یک نقشه راهنما عمل میکند و به سیستم هوش مصنوعی نشان میدهد که چه عناصری (گربه، کلاه، جنگل) باید در تصویر حضور داشته باشند و چگونه با یکدیگر تعامل کنند.

به بیان دقیقتر، این بردارهای عددی اطلاعاتی درباره روابط بین اجزای متن (مانند قرار گرفتن کلاه روی سر گربه، نه در کنار آن) و ویژگیهای بصری (مانند رنگ، بافت یا سبک) را کدگذاری میکنند. این مرحله برای اطمینان از همراستایی تصویر نهایی با خواسته کاربر حیاتی است.

۲. فرآیند خلق تصویر: از دادههای خام تا تصویر نهایی

پس از تحلیل متن و تولید نقشه عددی، سیستم هوش مصنوعی وارد مرحله خلق تصویر میشود. این مرحله شامل استفاده از مدلهای مولد است که با بهرهگیری از الگوریتمهای پیچیده، دادههای خام (مانند نویز تصادفی) را به تصاویری با معنا و ساختار تبدیل میکنند. سه فناوری اصلی در این حوزه عبارتاند از: شبکههای مولد تخاصمی (GANs)، مدلهای انتشار (Diffusion Models) و انتقال سبک عصبی (Neural Style Transfer). هر یک از این روشها رویکرد متفاوتی برای تولید تصویر دارند که در ادامه تشریح میشوند.

الف) شبکههای مولد تخاصمی (GANs)

شبکههای مولد تخاصمی، که در سال ۲۰۱۴ توسط یان گودفلو و همکارانش معرفی شدند، یکی از پرکاربردترین فناوریها در تولید تصاویر هستند. این شبکهها از دو بخش اصلی تشکیل شدهاند: شبکه مولد و شبکه تشخیصدهنده.

- شبکه مولد با دریافت یک بردار تصادفی (که معمولاً نویزی بدون ساختار است)، تلاش میکند تصویری تولید کند که شبیه تصاویر واقعی باشد. این شبکه مانند هنرمندی است که از یک صفحه خالی شروع میکند و با استفاده از دانش خود (که از دادههای آموزشی بهدستآمده) تصویری خلق میکند.

- شبکه تشخیصدهنده نقش یک منتقد را ایفا میکند که وظیفه دارد تصاویر تولیدشده توسط مولد را با تصاویر واقعی مقایسه کند و تشخیص دهد که آیا تصویر جعلی است یا واقعی. این شبکه با مجموعهای از تصاویر واقعی آموزش دیده و معیارهایی برای ارزیابی اصالت تصاویر دارد.

این دو شبکه در یک فرآیند رقابتی (Adversarial) با یکدیگر تعامل میکنند. مولد سعی میکند تشخیصدهنده را فریب دهد و تصاویری تولید کند که واقعی به نظر برسند، درحالیکه تشخیصدهنده تلاش میکند تصاویر جعلی را شناسایی کند. این رقابت با بهروزرسانی مداوم هر دو شبکه ادامه مییابد: اگر تشخیصدهنده تصویر را جعلی تشخیص دهد، مولد پارامترهای خود را تنظیم میکند تا در دور بعدی تصویر بهتری تولید کند. این فرآیند تا زمانی ادامه مییابد که تصاویر تولیدشده به حدی واقعی شوند که تشخیصدهنده نتواند آنها را از تصاویر واقعی متمایز کند.

برای مثال، در تولید تصویر «گربه با کلاه جادوگری در جنگل»، مولد با استفاده از نقشه عددی تولیدشده توسط CLIP، تلاش میکند تصویری خلق کند که شامل گربه، کلاه و محیط جنگل باشد. تشخیصدهنده این تصویر را با تصاویر واقعی گربهها و جنگلها مقایسه میکند تا از صحت جزئیات (مانند بافت خز گربه یا نورپردازی جنگل) مطمئن شود.

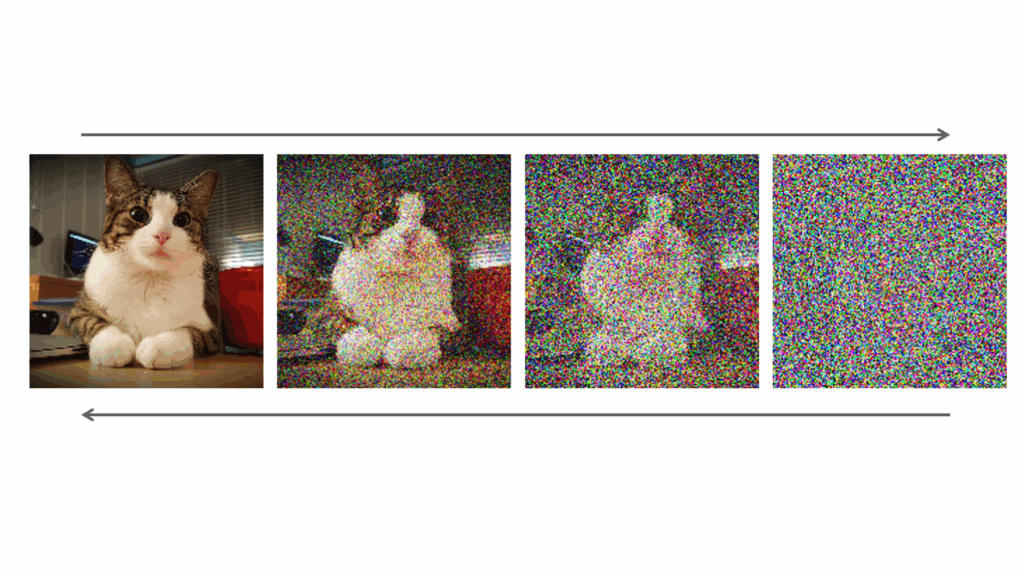

ب) مدلهای انتشاری (Diffusion Models)

مدلهای انتشار، که در ابزارهایی مانند DALL-E 2 و Stable Diffusion استفاده میشوند، رویکرد متفاوتی برای تولید تصویر دارند. این مدلها با الهام از فرآیندهای فیزیکی مانند پخش ذرات، تصاویر را از نویز تصادفی بهصورت تدریجی خلق میکنند. این فرآیند را میتوان به نقاشی تشبیه کرد که از یک بوم پر از خطوط و رنگهای درهم آغاز میشود و بهتدریج به یک اثر هنری منظم تبدیل میگردد.

فرآیند مدلهای انتشار شامل دو مرحله اصلی است:

- انتشار رو به جلو (Forward Diffusion): در این مرحله، یک تصویر واقعی بهتدریج با افزودن نویز گاوسی (نوعی نویز تصادفی) تخریب میشود. این فرآیند در چندین گام انجام میشود تا تصویر به یک نویز کاملاً تصادفی تبدیل شود. هدف این مرحله، آموزش مدل برای درک چگونگی تغییر تصویر در اثر افزودن نویز است.

- انتشار معکوس (Reverse Diffusion): پس از آموزش، مدل یاد میگیرد که فرآیند را معکوس کند، یعنی از یک نویز تصادفی شروع کند و با حذف تدریجی نویز، تصویر معناداری خلق کند. در این مرحله، مدل از نقشه عددی تولیدشده توسط متن ورودی (مانند توضیح گربه با کلاه) استفاده میکند تا نویز را به شکلی هدایت کند که تصویر نهایی با درخواست کاربر همخوانی داشته باشد.

این فرآیند به دلیل تواناییاش در تولید تصاویر با جزئیات بالا و کیفیت بصری فوقالعاده، بسیار محبوب شده است. برای مثال، در Stable Diffusion، مدل با استفاده از متن ورودی و چندین مرحله حذف نویز، میتواند تصویری خلق کند که نهتنها گربه و کلاه را نشان دهد، بلکه جزئیاتی مانند سایههای جنگل یا بافت پارچه کلاه را نیز بهخوبی بازتولید کند.

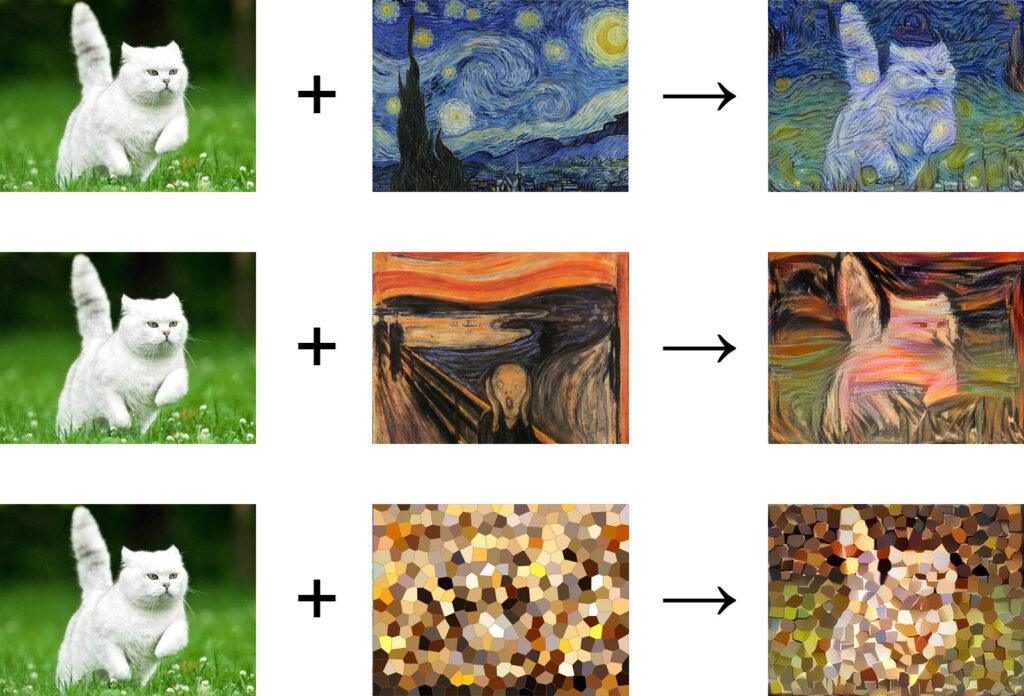

ج) انتقال سبک عصبی (Neural Style Transfer)

انتقال سبک عصبی روشی است که برای ترکیب محتوای یک تصویر با سبک بصری تصویر دیگر استفاده میشود. این فناوری بهویژه برای خلق آثار هنری جذاب کاربرد دارد. در این روش، سه تصویر اصلی دخیل هستند:

- تصویر محتوا: تصویری که محتوای اصلی آن (مانند شکل یک گربه) باید حفظ شود.

- تصویر سبک: تصویری که سبک بصری آن (مانند نقاشیهای ونگوگ با خطوط چرخشی و رنگهای زنده) باید اعمال شود.

- تصویر تولیدشده: تصویری که در ابتدا ممکن است کپی تصویر محتوا یا نویز تصادفی باشد و بهتدریج با ترکیب محتوا و سبک اصلاح میشود.

این فرآیند با استفاده از شبکههای کانولوشنی (Convolutional Neural Networks) انجام میشود که لایههای مختلفی برای تحلیل تصویر دارند. لایههای ابتدایی ویژگیهای ساده مانند لبهها و رنگها را تشخیص میدهند، درحالیکه لایههای عمیقتر الگوهای پیچیدهتر مانند بافتها و اشکال را شناسایی میکنند. انتقال سبک عصبی از این لایهها برای محاسبه دو معیار استفاده میکند:

- خطای محتوا (Content Loss): این معیار تضمین میکند که تصویر تولیدشده محتوای اصلی تصویر (مانند شکل گربه) را حفظ کند.

- خطای سبک (Style Loss): این معیار اطمینان میدهد که بافتها، رنگها و الگوهای تصویر تولیدشده با تصویر سبک (مانند سبک ونگوگ) همخوانی داشته باشد.

سپس، با استفاده از یک الگوریتم بهینهسازی (مانند گرادیان نزولی)، تصویر تولیدشده بهگونهای اصلاح میشود که مجموع خطای محتوا و سبک به حداقل برسد. نتیجه، تصویری است که محتوای اصلی را با سبک بصری جدید ترکیب کرده است، مانند گربهای که به سبک نقاشیهای ونگوگ ترسیم شده باشد.

۳. نقش دادههای آموزشی: قلب تپنده هوش مصنوعی

تمامی این فناوریها به دادههای آموزشی وابستهاند. شبکههای عصبی مورداستفاده در تولید تصاویر با مجموعههای عظیمی از تصاویر و توضیحات متنی آموزش میبینند. برای مثال، مدلهایی مانند DALL-E یا Stable Diffusion با میلیونها تصویر از منابع عمومی (مانند اینترنت) آموزش دیدهاند تا ویژگیهای بصری مانند شکل، رنگ، بافت و سبک را یاد بگیرند.

این دادهها به مدلها کمک میکنند تا الگوهای بصری را درک کنند و بتوانند تصاویر جدیدی خلق کنند که با دادههای آموزشی همخوانی داشته باشند. بااینحال، کیفیت و تنوع این دادهها تأثیر مستقیمی بر عملکرد مدل دارد. اگر دادهها محدود یا دارای سوگیری باشند (مانند کمبود تصاویر از گروههای خاص)، تصاویر تولیدشده ممکن است ناقص یا غیرمنصفانه باشند.

۴. هماهنگی نهایی: تنظیم و بهینهسازی

پس از تولید تصویر اولیه، معمولاً نیاز به تنظیمات نهایی است. این تنظیمات ممکن است شامل اصلاح جزئیات (مانند بهبود وضوح تصویر) یا تغییر سبک بصری باشد. برخی ابزارها مانند DALL-E امکان ویرایش تصاویر تولیدشده یا افزودن عناصر جدید (مانند گسترش پسزمینه) را فراهم میکنند. این مرحله به کاربر اجازه میدهد تا تصویر را دقیقاً به شکل دلخواه خود درآورد.

ابزارهای معروف تولید عکس با هوش مصنوعی

حالا که فهمیدیم این فناوری چطور کار میکند، بیایید نگاهی به چند ابزار معروف بیندازیم که در دنیای تولید عکس با هوش مصنوعی میدرخشند.

DALL-E 2: این ابزار که توسط OpenAI ساخته شده، یکی از پیشگامان این حوزه است. DALL-E 2 میتواند با یک متن ساده، تصاویری با کیفیت بالا خلق کند، از نقاشیهای دیجیتال گرفته تا تصاویر واقعی. این ابزار از مدلهای انتشار استفاده میکند و به لطف فناوری CLIP، متن و تصویر را به خوبی به هم مرتبط میکند. نکته جالب این است که DALL-E 2 حتی میتواند تصاویر موجود را ویرایش کند یا بخشهایی از آنها را گسترش دهد.

Midjourney: اگر به دنبال تصاویری با حس و حال نقاشی و هنرمندانه هستید، Midjourney انتخابی عالی است. این ابزار که از طریق Discord کار میکند، تصاویری خلق میکند که پر از جزئیات، رنگهای هماهنگ و ترکیببندیهای زیبا هستند. Midjourney هم از مدلهای انتشار استفاده میکند و به خاطر خروجیهای خلاقانهاش در میان هنرمندان دیجیتال بسیار محبوب شده.

Stable Diffusion: این ابزار به خاطر متنباز بودنش معروف است، یعنی هرکسی میتواند کد آن را بررسی یا تغییر دهد. Stable Diffusion تصاویری با کیفیت بالا تولید میکند و حتی روی کامپیوترهای معمولی هم قابل اجراست. این ویژگی باعث شده که افراد زیادی، از توسعهدهندگان تا هنرمندان، به آن روی بیاورند.

کاربردهای تولید عکس با هوش مصنوعی

تولید عکس با هوش مصنوعی فقط برای سرگرمی نیست؛ این فناوری در دنیای واقعی کاربردهای شگفتانگیزی دارد. در صنعت سرگرمی، از این ابزارها برای خلق محیطها و شخصیتهای بازیهای ویدیویی یا فیلمها استفاده میشود. مثلاً فیلمی به نام The Frost تماماً با تصاویر تولیدشده توسط DALL-E 2 ساخته شده، که خودش یک انقلاب در فیلمسازی است.

در بازاریابی و تبلیغات، این فناوری به شرکتها کمک میکند بدون نیاز به عکاسی گرانقیمت، تصاویر حرفهای برای کمپینهایشان بسازند. مجله Cosmopolitan در سال 2022 برای اولین بار جلد خود را با یک تصویر تولیدشده توسط DALL-E 2 منتشر کرد که نشاندهنده قدرت این فناوری در خلق محتوای بصری است.

در پزشکی هم هوش مصنوعی نقش مهمی ایفا میکند. این ابزارها میتوانند تصاویر رادیولوژی مثل ایکسری یا امآرآی را بهبود دهند یا حتی بخشهای گمشده یک تصویر را بازسازی کنند. این کار به پزشکان کمک میکند تشخیص دقیقتری داشته باشند و حتی میتواند به توسعه ابزارهای جدید در پزشکی سرعت ببخشد.

چالشها و جنجالهای تولید عکس با هوش مصنوعی

با همه این شگفتیها، تولید عکس با هوش مصنوعی بدون چالش نیست. یکی از مشکلات اصلی، کیفیت و اصالت تصاویر است. گاهی اوقات هوش مصنوعی در خلق جزئیات دقیق، مثل چهرههای انسانی یا دستها، به مشکل میخورد. مثلاً ممکن است دستها انگشتهای اضافی داشته باشند یا چهرهها کمی غیرطبیعی به نظر برسند.

مسئله دیگر، وابستگی به دادههای آموزشی است. اگر دادههایی که هوش مصنوعی با آنها آموزش دیده، تنوع کافی نداشته باشند، تصاویر تولیدی ممکن است تعصبات نژادی، جنسیتی یا فرهنگی را منعکس کنند. این موضوع در پروژهای به نام Gender Shades نشان داده شد که مشخص کرد برخی سیستمهای هوش مصنوعی در تشخیص چهره افراد با پوست تیرهتر دقت کمتری دارند.

از نظر حقوقی هم مشکلات زیادی وجود دارد. گاهی تصاویر تولیدشده شبیه آثار copyrighted میشوند، که میتواند به دعواهای قانونی منجر شود. در سال 2023، چند هنرمند از شرکتهای تولیدکننده ابزارهای هوش مصنوعی شکایت کردند، چون معتقد بودند این شرکتها بدون اجازه از آثارشان برای آموزش استفاده کردهاند. همچنین، تعیین مالکیت تصاویر تولیدی یک چالش بزرگ است. مثلاً وقتی یک اثر تولیدشده توسط هوش مصنوعی در مسابقه هنری برنده شد، بحثهای زیادی درباره اینکه آیا این اثر واقعاً «اصل» است یا نه به وجود آمد.

یکی از نگرانیهای بزرگتر، گسترش دیپفیکهاست. این تصاویر یا ویدیوهای جعلی میتوانند برای انتشار اطلاعات نادرست یا حتی آسیب زدن به افراد استفاده شوند. مثلاً در سال 2023، تصاویری جعلی از دستگیری یک شخصیت سیاسی معروف در اینترنت پخش شد که کاملاً توسط Midjourney ساخته شده بود. تشخیص این تصاویر جعلی روزبهروز سختتر میشود و این موضوع میتواند برای رسانهها و جامعه چالشبرانگیز باشد.

آینده تولید عکس با هوش مصنوعی

آیا روزی هوش مصنوعی جای هنرمندان را خواهد گرفت؟ احتمالاً نه. هوش مصنوعی، با همه قدرتش، هنوز نمیتواند احساسات عمیق انسانی یا خلاقیتهای غیرقابل توصیف با کلمات را بازتولید کند. همانطور که یک نویسنده معروف گفته، بعضی از آثار هنری را نمیتوان با زبان توصیف کرد، و اینجاست که هوش مصنوعی به محدودیت میرسد. به جای جایگزینی، هوش مصنوعی احتمالاً به ابزاری تبدیل خواهد شد که به هنرمندان کمک میکند ایدههایشان را سریعتر و خلاقانهتر به واقعیت تبدیل کنند.

در آینده، انتظار میرود این فناوری حتی پیشرفتهتر شود. ابزارهایی مثل DALL-E و Midjourney احتمالاً تصاویری با کیفیتتر و واقعیتر تولید خواهند کرد، و کاربردهایشان در حوزههایی مثل آموزش، طراحی محصول و حتی معماری گسترش خواهد یافت. اما همراه با این پیشرفتها، نیاز به قوانین واضحتر برای مسائل حقوقی و اخلاقی هم بیشتر خواهد شد.

منبع: altexsoft